科技工作者之家

科技工作者之家APP是专注科技人才,知识分享与人才交流的服务平台。

科技工作者之家 2021-03-18

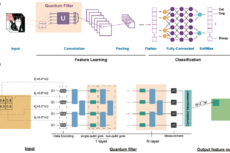

摘要:卷积神经网络在各个领域都发挥着重要的作用,尤其是在计算机视觉领域,但过多的参数数量和计算量限制了它在移动设备上的应用。针对上述问题,结合分组卷积方法和参数共享、密集连接的思想,提出了一种新的卷积算法Group-Shard-Dense-Channle-Wise。利用该卷积算法,在PeleeNet网络结构的基础上,改进出一种高效的轻量化卷积神经网络——GSDCPeleeNet。与其他卷积神经网络相比,该网络在具有更少参数的情况下,几乎不损失识别精度甚至识别精度更高。该网络选取1×1卷积层中卷积核信道方向上的步长s作为超参数,调整并适当地选取该超参数,可以在网络参数量更小的情况下,拥有更好的图像分类效果。

关键词:图像分类、卷积神经网络、轻量化、密集连接、参数共享

0 引言

随着深度学习理论的提出和硬件设备计算速度的不断突破,卷积神经网络在近年来得以迅速发展。2012年,AlexNet[1]在ImageNet大规模视觉识别挑战赛中获得了图像分类冠军。之后,为了提高网络模型的准确率,研究人员不断地加深卷积网络的深度,相继提出了性能更加优越的卷积神经网络,如VGG16[2]、GoogLeNet[3]和DenseNet[4]等。

这些网络准确率普遍较高,但是有着非常复杂的模型和很深的层次,参数量十分巨大。在实际生活的应用中,模型往往需要在资源有限的嵌入式设备和移动设备上运行。因此,研究人员开始着手研究,并且相继提出了更高效的轻量级卷积神经网络。它们保持了网络的性能,大大减少了模型的参数量,从而减少计算量,提升了模型速度。

旷视科技的ShuffleNet在ResNet[5]单元上进行了改进,有两个创新的地方:逐点分组卷积和通道混洗[6]。WANG R J等提出的PeleeNet是一种轻量级网络,它在DenseNet基础上进行了改进和创新,主要有五个方面的结构改进[7]。ZHANG J N等提出了一种卷积核及其压缩算法,通过这种卷积方法,ZHANG J N等发明了轻量卷积神经网络SDChannelNets[8]

可以看出,上述轻量卷积神经网络均存在一定不足。在使用分组卷积时,为了解决分组卷积导致的信息丢失问题,需要增加额外的操作。在运用1×1卷积时,会导致1×1卷积的参数量在网络总参数量中占据大部分。通过分析,这些网络需要通过调整相应的超参数来提高网络识别精度。这些操作往往会大大增加网络模型参数量。

为了解决这个不足,本文结合参数共享、密集连接的卷积方法和分组卷积,基于PeleeNet网络,提出了轻量级卷积神经网络架构GSDCPeleeNet。适当调节超参数,在损失较小准确度甚至拥有更高准确度的情况下,减小了模型的参数量。

来源:电子技术应用ChinaAET

原文链接:http://mp.weixin.qq.com/s?__biz=MzA4NjQwNjMwOA==&mid=2650492283&idx=3&sn=dabb0a1971c21291ef42e5d2ad64b5aa

版权声明:除非特别注明,本站所载内容来源于互联网、微信公众号等公开渠道,不代表本站观点,仅供参考、交流、公益传播之目的。转载的稿件版权归原作者或机构所有,如有侵权,请联系删除。

电话:(010)86409582

邮箱:kejie@scimall.org.cn

深度学习神经网络方法获改进

量子增强机器学习:量子经典混合卷积神经网络

谷歌开发新式AI算法,可绘制大脑神经系统图像

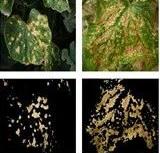

【论文精选】多尺度融合卷积神经网络的黄瓜病害叶片图像分割方法

基于卷积神经网络的高铁车轮损伤识别方法研究

如何入手卷积神经网络

认知神经学家借助人工智能研究人脑

AI可穿透墙壁识别人的动作

基于依存句法驱动注意力图卷积神经网络的关系抽取

【论文精选】基于RAdam卷积神经网络的水稻生育期图像识别